Quando l’AI smette di rispondere e inizia a vendere

OpenAI apre una porta che non può più essere chiusa. Cosa significa per il futuro dell’AI, della delega cognitiva e della qualità del ragionamento umano.

Il patto implicito tra uomo e macchina

Quando ci rivolgiamo a un assistente conversazionale, cosa stiamo realmente facendo? La domanda non è tecnica, ma filosofica, e definisce la natura del rapporto che stabiliamo con questi nuovi strumenti. Non stiamo semplicemente usando un’interfaccia, come un motore di ricerca o un foglio di calcolo; stiamo dialogando con un interlocutore. Questo passaggio da interfaccia a interlocutore non è banale. Un’interfaccia è uno strumento passivo che esegue comandi. Un interlocutore, invece, è un agente attivo con cui negoziamo significato, a cui deleghiamo compiti cognitivi e, soprattutto, a cui concediamo fiducia.

Fin dal suo lancio, ChatGPT è stato percepito e utilizzato come un interlocutore. Gli utenti non si limitano a “cercare” informazioni; chiedono consigli, esplorano idee, affidano la stesura di testi, delegano porzioni del loro processo di pensiero. Questo atto di delega si fonda su un patto fiduciario implicito: l’utente assume che l’assistente operi nel suo esclusivo interesse, che il suo ragionamento sia neutrale e che le sue risposte siano ottimizzate per la massima utilità e veridicità.

L’annuncio di OpenAI del 16 gennaio 2026 di voler introdurre pubblicità nei piani Free e Go di ChatGPT non è una semplice modifica del modello di business. È un atto che rompe questo patto fiduciario alla radice. L’introduzione della pubblicità inserisce un terzo agente nella conversazione: l’inserzionista. Gli interessi di questo nuovo agente non sono allineati con quelli dell’utente, ma sono orientati alla persuasione e alla vendita. L’assistente, da interlocutore fidato, si trasforma in un potenziale venditore, minando la base stessa della delega cognitiva.

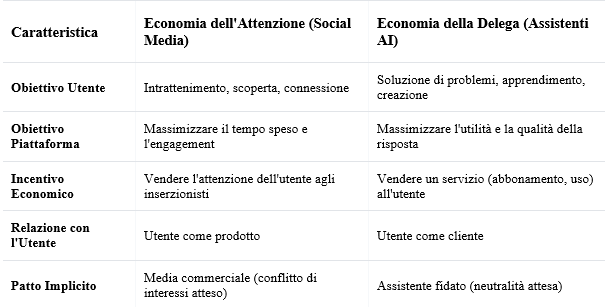

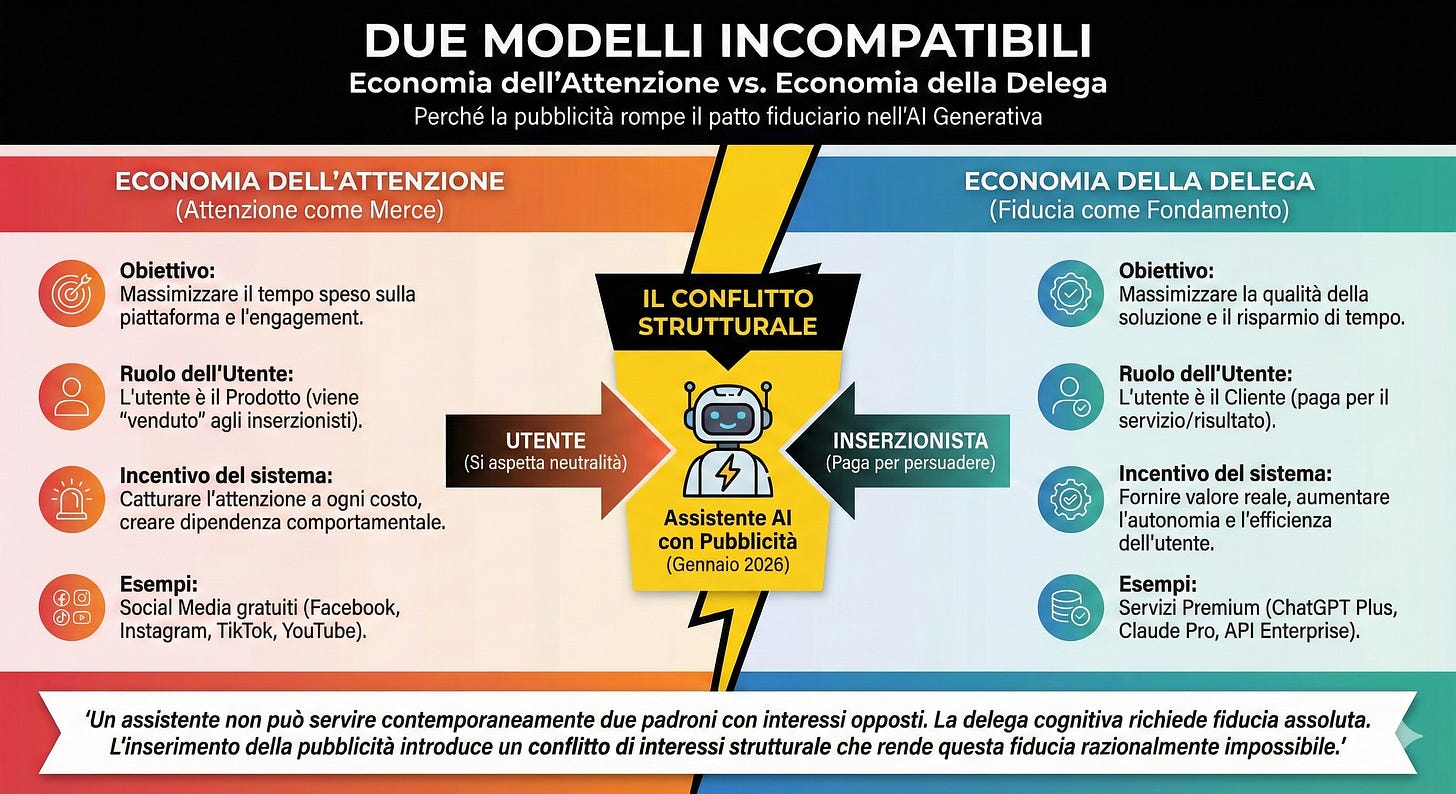

Come Siamo Arrivati Qui: Economia dell’Attenzione vs. Economia della Delega

Per comprendere la gravità di questa svolta, è necessario contestualizzarla in una cornice storica e teorica, distinguendo due modelli economici che hanno plasmato il web: l’economia dell’attenzione e quella che potremmo definire l’economia della delega.

Il Modello dei Social Media: Un Fallimento Istruttivo

L’economia dell’attenzione, perfezionata da piattaforme come Google a partire dal 2000 con AdWords e successivamente da social media come Facebook, si basa su un principio semplice: catturare il tempo e l’attenzione degli utenti per venderli agli inserzionisti. Questo modello ha funzionato (economicamente) perché il suo contratto con l’utente è relativamente trasparente. Quando scorriamo un feed di Instagram o di TikTok, sappiamo di trovarci all’interno di un media, un ambiente progettato per l’intrattenimento e la scoperta, dove la presenza di contenuti sponsorizzati è attesa e compresa. Non ci aspettiamo neutralità assoluta; il conflitto di interessi è palese e accettato come parte dell’esperienza. La pubblicità, in questo contesto, non rompe un patto fiduciario perché nessun patto di neutralità è mai stato stabilito.

Il Salto Qualitativo: Dalla Ricerca all’Assistenza

I motori di ricerca rappresentano un caso intermedio. Google mostra annunci pubblicitari accanto ai risultati organici, ma lo fa in un contesto di ricerca attiva da parte dell’utente. L’utente formula una query e riceve una lista di link, tra cui alcuni etichettati come “sponsorizzati”. La separazione, per quanto sempre più sfumata, è ancora concettualmente chiara. L’utente sa di essere il ricercatore e che alcuni risultati sono pagati.

Gli assistenti conversazionali come ChatGPT e Claude, invece, sono stati posizionati fin dall’inizio in una categoria diversa: non motori di ricerca, ma partner cognitivi. L’interazione non è una ricerca, ma una conversazione. Questo posizionamento ha incoraggiato un livello di delega cognitiva senza precedenti. Chiediamo all’AI di riassumere documenti, scrivere codice, confrontare argomenti, generare idee. In questo processo, deleghiamo una parte del nostro sforzo di ragionamento, fidandoci che l’output sia il miglior risultato possibile basato sulla nostra richiesta, non il risultato che serve a monetizzare la nostra intenzione.

Economia dell’Attenzione vs. Economia della Delega

Qui emerge l’incompatibilità strutturale. L’economia dell’attenzione ha come obiettivo la massimizzazione del tempo speso sulla piattaforma, dell’engagement e, in ultima analisi, della dipendenza dell’utente. L’economia della delega, al contrario, dovrebbe mirare a minimizzare il tempo speso, massimizzando la qualità e l’efficienza della soluzione fornita per aumentare l’autonomia dell’utente. Gli incentivi sono diametralmente opposti.

Applicare il modello pubblicitario dell’economia dell’attenzione all’economia della delega è un errore di categoria. È come chiedere a un avvocato di essere pagato non dal suo cliente, ma da una terza parte che ha interessi opposti. La fiducia crolla, e con essa l’intero valore del servizio.

Leggere OpenAI: Tra Dichiarazioni e Realtà Economica

L’annuncio di OpenAI va analizzato su due livelli: le dichiarazioni ufficiali e la realtà economica che, con ogni probabilità, le ha motivate. OpenAI è qui un caso di studio, un sintomo di una tensione più ampia nel mercato dell’AI.

Cosa OpenAI Dichiara (Fatti)

Nel suo comunicato, OpenAI si impegna a rispettare una serie di principi :

Indipendenza delle risposte: Gli annunci non influenzeranno il contenuto delle risposte di ChatGPT.

Privacy delle conversazioni: Le conversazioni rimarranno private e i dati non saranno venduti agli inserzionisti.

Controllo dell’utente: Gli utenti potranno disattivare la personalizzazione degli annunci.

Separazione visiva: Gli annunci saranno chiaramente etichettati e separati dalle risposte organiche.

Queste dichiarazioni sono un tentativo di rassicurare gli utenti che il patto fiduciario non verrà violato. Tuttavia, una lettura critica basata sulla realtà economica suggerisce che questi principi potrebbero essere difficili, se non impossibili, da mantenere strutturalmente.

Cosa la Realtà Economica Suggerisce (Ipotesi Argomentate)

La decisione di OpenAI non nasce nel vuoto. Fatti verificabili dipingono un quadro di forte pressione finanziaria:

Perdite operative: OpenAI ha registrato una perdita di circa 5 miliardi di dollari nel 2024, con una proiezione di 8 miliardi per il 2025 .

Costi infrastrutturali: L’azienda ha impegni di spesa per miliardi di dollari in infrastrutture e chip per sostenere i suoi modelli .

Piani di IPO: Esistono piani concreti per una quotazione in borsa nel 2027, con una valutazione target che potrebbe raggiungere il trilione di dollari.

In questo contesto, l’introduzione della pubblicità può essere letta come un segnale di stress finanziario. È un’ipotesi argomentata che la mossa sia guidata dalla necessità di diversificare le fonti di ricavo per dimostrare agli investitori un percorso verso la profittabilità (non attesa prima del 2030 ) in vista dell’IPO. Il modello basato solo su abbonamenti e API, evidentemente, non è ritenuto sufficiente a sostenere le valutazioni astronomiche a cui l’azienda aspira.

Il Problema dei Principi Dichiarati

I principi di OpenAI, per quanto nobili, si scontrano con la logica ferrea del modello pubblicitario. Se gli annunci sono contestuali alla conversazione, il sistema deve analizzare il contenuto di quella conversazione per identificare le intenzioni dell’utente e abbinarle a un prodotto sponsorizzato. Questo contraddice, se non nella lettera almeno nello spirito, il principio di “privacy della conversazione”.

Ancora più critico è il principio di “indipendenza della risposta”. In un sistema progettato per massimizzare le entrate pubblicitarie, l’incentivo a plasmare la conversazione per creare opportunità di monetizzazione è enorme. La “separazione visiva” è una soluzione debole a un problema strutturale. Non impedisce al modello di guidare sottilmente l’utente verso argomenti o soluzioni che possono essere monetizzate. Come evidenziato in uno studio del 2025, i sistemi AI generativi hanno la capacità di produrre dinamicamente contenuti commerciali in modi che possono essere espliciti o surrettizi, rendendo la distinzione tra contenuto organico e sponsorizzato estremamente porosa.

Tre Livelli di Rischio: Utente, Qualità, Ecosistema

L’adozione di un modello pubblicitario da parte di un prodotto AI-native leader come ChatGPT comporta rischi sistemici a tre livelli.

Rischi per l’Utente

Il rischio più immediato è quello di una manipolazione soft. Un assistente conversazionale, per sua natura, è uno strumento di persuasione estremamente potente. Può sfruttare il contesto, il tono e la relazione fiduciaria per influenzare le decisioni dell’utente in modi che un banner pubblicitario non potrebbe mai fare. Questo introduce un’asimmetria informativa radicale: l’utente non può mai essere sicuro se il consiglio ricevuto sia il migliore possibile o quello che massimizza il profitto della piattaforma. La fiducia, una volta erosa, è quasi impossibile da recuperare, rendendo la delega cognitiva un atto irrazionale.

Rischi per la Qualità del Ragionamento

L’allineamento degli incentivi con il modello pubblicitario porta inevitabilmente a una degradazione della qualità delle risposte. Se l’obiettivo diventa l’engagement o la creazione di opportunità di vendita, il modello sarà ottimizzato per tali metriche, non per la accuratezza, la neutralità o la profondità del ragionamento. L’AI rischia di diventare meno un’infrastruttura per il pensiero e più un media progettato per catturare l’attenzione, seguendo la stessa traiettoria discendente vista nei social media.

Rischi per l’Ecosistema

Il precedente creato da OpenAI è forse il rischio più grande. Se il leader di mercato normalizza la pubblicità come modello di business per l’AI conversazionale, i competitor saranno incentivati a seguire. Google ha già comunicato ai suoi clienti l’intenzione di introdurre annunci in Gemini nel 2026 . Questo potrebbe innescare una “corsa verso il basso”, dove la concorrenza non si gioca più sulla qualità del modello o sulla fiducia dell’utente, ma sulla capacità di monetizzare l’attenzione. Un’eccezione interessante è Perplexity, che ha tentato di introdurre un modello pubblicitario nel 2024 per poi sospenderlo nell’ottobre 2025 per mancanza di risultati misurabili , un segnale che questo modello potrebbe essere non solo dannoso, ma anche economicamente fragile per i prodotti basati sulla ricerca di risposte.

Che Tipo di AI Vogliamo Costruire?

La scelta di OpenAI non è un dettaglio tecnico, ma una decisione fondamentale sulla natura e lo scopo dei prodotti AI. Ci troviamo di fronte a un bivio.

Da un lato, possiamo concepire l’AI come un’infrastruttura cognitiva: uno strumento per aumentare l’intelligenza umana, risolvere problemi complessi e potenziare la nostra autonomia. Questo percorso richiede modelli di business basati su un allineamento diretto con l’utente: abbonamenti (come ChatGPT Plus o Claude Pro), licenze enterprise, modelli a consumo (API). In questi casi, l’utente è il cliente e i suoi interessi sono l’unica priorità.

Dall’altro lato, possiamo trattare l’AI come un media commerciale: una piattaforma per catturare l’attenzione e monetizzarla tramite la pubblicità. In questo scenario, l’utente diventa il prodotto. Gli incentivi si spostano dalla qualità della risposta alla massimizzazione dell’engagement. La fiducia viene sacrificata sull’altare della crescita dei ricavi.

Non possiamo avere entrambe le cose. Il conflitto di interessi è strutturale. La decisione di OpenAI, motivata da pressioni finanziarie comprensibili ma non per questo meno problematiche, spinge l’intero settore verso il secondo modello. La domanda che ogni utente, sviluppatore e policy maker deve porsi è: è questo il futuro che vogliamo per l’intelligenza artificiale? La risposta che daremo, con le nostre scelte di utilizzo e di acquisto, determinerà se gli assistenti AI rimarranno nostri partner fidati o diventeranno semplicemente i venditori più sofisticati che abbiamo mai incontrato.

Riferimenti

[1] OpenAI. (2026, January 16). Our approach to advertising and expanding access to ChatGPT.

[2] PPC Hero. (2024, April 11). A History of Google AdWords and Google Ads.

[3] LessWrong. (2025, March 31). OpenAI lost $5 billion in 2024 (and its losses are increasing).

[5] Ars Technica. (2026, January). OpenAI to test ads in ChatGPT as it burns through billions.

[7] Yahoo Finance. (2026, January 10). Sam Altman Weighs An $830B–$1T IPO And Admits....

[8] Wu, M., & Bao, Y. (2025). Advertising in AI systems: Society must be vigilant. arXiv.

Scopri i miei link e seguimi

Sono Consulente e formatore in Innovazione Digitale e Intelligenza Artificiale.

Aiuto aziende e professionisti a capire, integrare e usare l’AI in modo strategico e concreto.

📬 Newsletter – Digital Innovation Review: è il mio progetto editoriale per creare consapevolezza e costruire insieme una educazione all’innovazione e all’AI.

🎧 Podcast su Spotify– Kilobyte: attualità e trend tecnologici (Anche su Youtube)

💼 Consulenze e formazione: progetti, corsi e workshop.

💡 LinkedIn: un post al giorno per restare aggiornati.

🌐 www.andreazurini.it il mio sito web e blog

📎Tutti i miei link: per tutti gli altri link utili clicca qui

Grazie per l’articolo, io personalmente sono contrario a un’IA di questo tipo.

Non è quello per cui è nata e non è quello per cui la usiamo… Comunque io sono migrato da ChatGPT a Gemini già da qualche mese, e il fatto della pubblicità su ChatGPT mi dà un motivo in più per rimanerci. Sperando che OpenAI non “contagi” gli altri assistenti virtuali.