Arrivano gli AI Agents: è l'inizio di una AI superiore?

ChatGPT era solo l'inizio, con GPT4 è possibile creare dei veri e propri AI Agents ovvero dei bot perfettamente autonomi ai quali dare un compito da portare a termine, vediamo come funzionano!

Cosa sono gli AI Agents

Arrivano gli AI Agents, ovvero dei bot potenziati da GPT4 in grado di portare a termine un compito, tramite una analisi, la ricerca e l’assimilazione delle informazioni dal Web, ne avevo parlato in questo post su Linkedin, ho deciso di approfondire l’argomento nella newsletter perché unendo i puntini si può notare come questa sarà la prossima evoluzione delle AI Generative, nonché un significativo passo avanti verso l’AGI ovvero una Intelligenza Artificiale Generale con coscienza di sé.

Immaginatevi in ufficio durante una normale giornata lavorativa e vi viene assegnata una mansione, come redigere un'analisi di mercato per un prodotto che la vostra azienda sta considerando di sviluppare. Questo processo avviene gradualmente: prima ci si familiarizza con l'argomento, poi si cercano documenti simili, si scrivono alcuni paragrafi e, se necessario, si chiede aiuto ai colleghi.

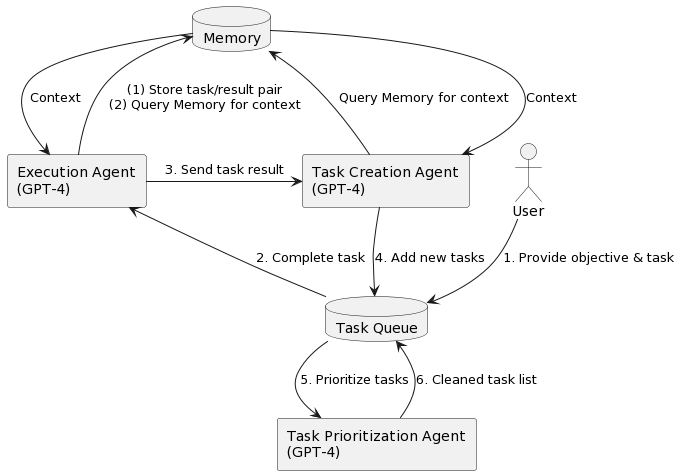

In sintesi, quando viene assegnato un compito a un essere umano, esso viene svolto attraverso diversi passaggi. È proprio questo tipo di processo che una nuova generazione di applicazioni basate sull'intelligenza artificiale sta cercando di emulare. Questi sistemi open source, per ora disponibili principalmente sotto forma di codice su GitHub, si basano sul modello GPT-4 e il più noto è AutoGPT. Questi software permettono di creare agenti autonomi basati sull'IA che, data un'ampia gamma di obiettivi, possono raggiungere soluzioni attraverso vari passaggi, che possono includere la ricerca sul web o l'esecuzione di codice.

Gli agenti AI Agents sono programmi informatici che svolgono compiti autonomamente senza intervento umano. Possono operare in modo autonomo o interagire con altri agenti o esseri umani attraverso il linguaggio naturale o altri mezzi. Gli AI Agents potranno essere utilizzati per varie applicazioni, come il servizio clienti, gli assistenti personali, lo sviluppo software, i giochi, la robotica e molto altro.

Mentre ChatGPT può svolgere un compito alla volta partendo da un input umano, ovvero un prompt (di prompting engineering ne avevo parlato qui), sistemi come AutoGPT riescono a raggiungere il risultato desiderato attraverso passaggi intermedi e in modo autonomo, superando anche i limiti di token di GPT-4. Queste applicazioni hanno molteplici usi, come ricerche di mercato o assistenza nella ricerca scientifica.

Andrej Karpathy, co-fondatore di OpenAI, illustra il processo con un'analogia su Twitter, affermando che ogni generazione di GPT può essere paragonata a un pensiero e, collegandoli, è possibile creare agenti che agiscono autonomamente in base a un obiettivo prestabilito.

Esistono già diverse versioni, come AutoGPT, BabyAGI, Camel e Jarvis di Microsoft, e una versione web-based chiamata AgentGPT accessibile tramite browser, con funzionalità avanzate riservate agli abbonati alle API di OpenAI, vediamole una ad una! Tutta questa esplosione di tool dimostra che basta unire Python alle potenzialità offerte dalle API di OpenAI per creare prodotti straordinari.

AutoGPT

“Auto-GPT è un'applicazione sperimentale open-source che mette in mostra le capacità del modello linguistico GPT-4. Questo programma, guidato da GPT-4, incatena i "pensieri" del LLM per raggiungere autonomamente qualsiasi obiettivo si voglia raggiungere. Come uno dei primi esempi di GPT-4 che funziona in modo completamente autonomo, Auto-GPT spinge i confini di ciò che è possibile fare con l'intelligenza artificiale.“

– AUTO GPT

AutoGPT è un'applicazione open-source sperimentale che utilizza GPT-4 per sviluppare e gestire autonomamente progetti, come creare siti web, scrivere articoli, generare loghi e promuovere prodotti. Ha anche accesso a Internet e può eseguire ricerche, raccogliere informazioni e interagire con piattaforme popolari come Twitter.

Tecnicamente, AutoGPT è un software scritto in Python e basato su GPT 4 e 3.5, utilizzato per interpretare gli obiettivi degli utenti, stabilire un piano d'azione e creare istruzioni intermedie. Dispone di una memoria a medio-lungo termine e può accedere al web e ai file forniti dall'utente. A differenza dei plugin di ChatGPT, l'IA decide autonomamente quali sistemi interrogare.

AutoGPT è uno dei primi esempi di GPT-4 che funziona in modo completamente autonomo senza supervisione o intervento umano. Questo significa che AutoGPT può apprendere dalle proprie esperienze e migliorare le proprie prestazioni nel tempo. Dispone inoltre di un sistema di memoria a lungo e breve termine che gli consente di immagazzinare e richiamare informazioni rilevanti per i suoi compiti.

👉 Link relativi a AutoGPT

A questo link trovate una guida completa per installare AutoGPT sul vostro PC

A questo link trovate invece un bel Thread Twitter sulle potenzialità di AutoGPT e BabyAGI

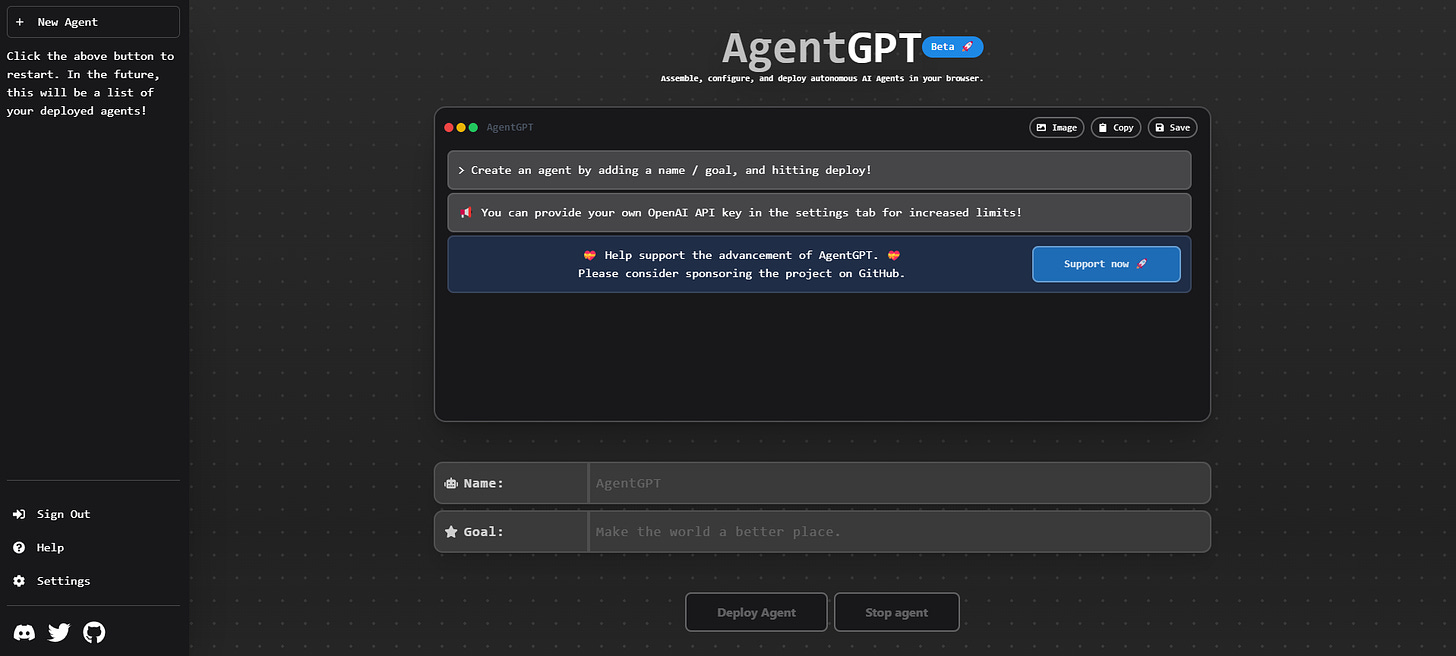

AgentGPT

AgentGPT è un applicazione web based che vi permette di lanciare un AI Agent direttamente da una tab del vostro browser, potrete chiamare il vostro AI Agent come preferite e dargli l’obiettivo (lecito) che volete.

AgentGPT consente di configurare e distribuire agenti AI autonomi. Date un nome alla vostra IA personalizzata e fatele intraprendere qualsiasi obiettivo immaginabile. Tenterà di raggiungere l'obiettivo pensando ai compiti da svolgere, eseguendoli e imparando dai risultati.

👉 Link relativi a AutoGPT

BabyAGI

Questo script Python è un esempio di un autonomo AI Agent alimentato da LLM. Il sistema utilizza le API di OpenAI per creare ed eseguire compiti. L'idea centrale del progetto è di fornire all'assistente gli strumenti necessari per svolgere qualsiasi compito possa essere esguito da un LLM. BabyAGI è in grado di eseguire codice in modo arbitrario e di controllare il proprio flusso e la propria memoria, sia attraverso il pre-addestramento, la messa a punto e l'ottimizzazione dei prompt.

Per ora BabyAGI è solo un Proof of Concept ma è in continuo sviluppo.

BabyAGI funziona in pratica come Auto-GPT, ma lo script Python è stato sviluppato da Yohei Nakajima con l’obiettivo di creare un business a partire da un prompt iniziale, in modo simile al progetto HustleGPT di Jackson Greathouse Fall.

Un ultima chicca la versione web di BabyAGI è accessibile anche tramite browser ed è chiamata God Mode.

👉 Link relativi a BabyAGI

LLaMA e i suoi parenti

L'open sourcing di "LLaMA", l'LLM di Meta, ha agito come una scintilla per ridare linfa alla comunità dell'IA open-source.

LLama è stato originariamente rilasciato in diversi formati: parametri 7B, 13B, 33B e 65B e, nonostante sia più piccolo di GPT-3, competeva nelle prestazioni in molte attività.

L'incredibile quantità di innovazione innescata in poche settimane è riassumibile nelle seguenti notizie:

✅ Stanford ha rilasciato Alpaca, un modello LLama che segue le istruzioni

✅ Vicuna è stata rilasciata dal University of California, Berkeley, Carnegie Mellon University, Stanford University e UC San Diego. È una versione ottimizzata di LLama che corrisponde alle prestazioni GPT-4

✅ Il Berkley AI Research Institute ha rilasciato Koala, una versione perfezionata di LLama

✅ Nebuly ChatLLama open source, un framework per la creazione di assistenti conversazionali utilizzando i propri dati

✅ FreedomGPT è stato rilasciato come agente conversazionale open source basato su Alpaca

✅ UC Berkeley ha rilasciato ColossalChat, un modello di tipo ChatGPT con pipeline RLHF (Reinforcement Learning from Human Feedback) basato su LLama.

E dulcis in fundo… 🤯

➡️ Databricks ha rilasciato Dolly, il primo LLM Instruction-Tuned veramente aperto al mondo, che può essere utilizzato per usi 🎊 🎉 commerciali.

JARVIS

Ora, sembra che Microsoft voglia replicare il suo successo con il lancio di "HuggingGPT", ora noto anche come "JARVIS". Questa tecnologia, costruita su ChatGPT, mira a sfruttare Hugging Face, uno dei maggiori pilastri della ricerca open-source sull'IA, per creare un nuovo approccio alla risoluzione di problemi complessi di IA.

I ricercatori di Microsoft hanno descritto in dettaglio un modo per utilizzare gli LLM come parte del sistema rivolta all'utente, sfruttando le loro capacità di linguaggio naturale per interfacciarsi con altri modelli. Questo sembra essere un po' il successore spirituale di "Visual ChatGPT", che utilizzava un approccio simile per collegare gli LLM ai modelli testo-immagine.

Chiamato così in onore dell'assistente AI personale di Iron Man, "JARVIS" mira a riunire la potenza della comunità open-source e di ChatGPT. Proprio come JARVIS accede al vasto arsenale di servizi di Tony Stark e agisce come una sorta di maggiordomo dell'intelligenza artificiale, HuggingGPT chiama modelli specializzati per determinati casi d'uso, interfacciandosi tra l'utente e i modelli.

👉 Link relativi a JARVIS

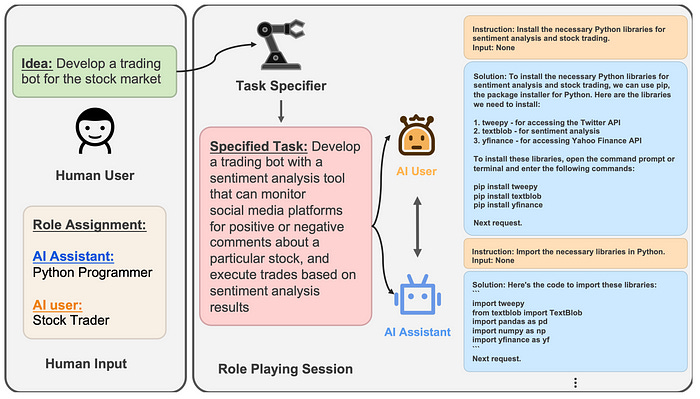

Camel

CAMEL (che sta per Communicative Agents for "Mind" Exploration of Large Scale Language Model Society) propone un framework per agenti di ruolo in cui due agenti AI comunicano tra loro:

1) agente user AI: impartisce istruzioni all'assistente AI con l'obiettivo di completare il compito.

2) agente assistent AI: segue le istruzioni dell'utente AI e risponde con soluzioni al compito.

3) Agente specificatore del compito: c'è un altro agente, chiamato agente specificatore del compito, che si occupa di elaborare un compito specifico che l'utente e l'assistente AI devono completare. Questo aiuta a scrivere una richiesta concreta di compito senza che l'utente debba spendere tempo per definirlo.

In questo esempio (nella figura in alto), un umano ha l'idea di sviluppare un bot di trading. L'utente AI è un trader di azioni e l'assistente AI è un programmatore Python. L'agente specifico per l'attività propone innanzitutto un'attività specifica con i relativi dettagli (monitorare il sentiment dei social media e negoziare azioni in base ai risultati dell'analisi del sentiment). Quindi l'agente dell'utente AI diventa il pianificatore del compito, l'agente dell'assistente AI diventa l'esecutore del compito e si interrogano a vicenda in un ciclo fino a quando non vengono soddisfatte alcune condizioni di terminazione.

L'essenza di Camel risiede nell'ingegneria dei prompt, cioè nell'inception prompt. I prompt sono infatti definiti con cura per assegnare i ruoli, impedire il ribaltamento dei ruoli, proibire il danneggiamento e le false informazioni e incoraggiare una conversazione coerente. Si vedano i prompt dettagliati nel documento di Camel.

👉 Link relativi a CAMEL

La città degli Agenti AI

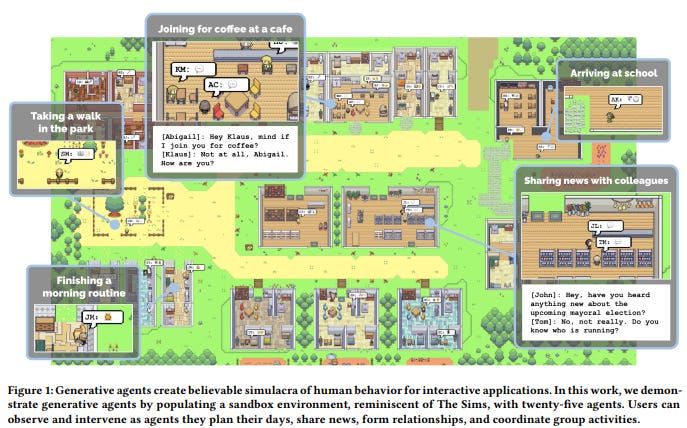

Una ricerca condotta dai ricercatori di Stanford e Google ha portato a straordinarie scoperte riguardo agli "agenti generativi", dimostrando le enormi potenzialità nel campo dell'intelligenza artificiale. Creando 25 personaggi in un videogioco di simulazione, i ricercatori sono riusciti a far interagire questi personaggi in modo simile agli umani, facendoli comunicare, memorizzare e riflettere sulle loro esperienze e formare piani per ogni giorno. I personaggi condividevano informazioni tra loro, formavano e ricordavano nuove relazioni e si coordinavano tra loro, agendo come veri esseri umani. Questa ricerca evidenzia un rapido progresso nell'IA, passando da modelli che scrivono post sul blog a modelli che imitano il comportamento umano.

👉 Qui trovate il link al documento: https://lnkd.in/gwYBN3jp

Stiamo dunque arrivando ad una AI superiore, la cosiddetta AGI?

AutoGPT ed i suoi fratelli non sono ancora una AGI, ma piuttosto la forma di AI più avanzata di quella fin’ora disponibile al grande pubblico, se le conversazioni di chatGPT possono essere paragonate a dei pensieri, gli AI Agent sono in grado di emulare dei ragionamenti. L'intelligenza artificiale generale (AGI) si riferisce invece a un livello ipotetico di intelligenza artificiale che può svolgere qualsiasi compito intellettuale che un essere umano può immaginare di fare. Tuttavia, generare testi non è lo stesso che capirli. AutoGPT ad esempio non ha alcuna conoscenza esplicita o rappresentazione del mondo, né ha obiettivi o motivazioni, la mancanza di consapevolezza non lo rende quindi ancora una primissima versione di un AGI.

Gli AI Agent restano però un modello impressionante e potente per la generazione di linguaggio naturale e potrebbero anche essere in grado di ingannare alcuni esseri umani con il proprio output e non è da escludersi che una futura AGI non basi i propri ragionamenti su evoluzioni di questi modelli.

Tuttavia, sistemi come questi sono ancora in fase embrionale e, nonostante l'attenzione mediatica, sono lontani dall'essere una soluzione di automazione affidabile per il grande pubblico, ma bisogna anche riconoscere che stanno migliorando molto rapidamente.

Bisognerebbe in quest’ottica pensare anche ad un Web ottimizzato anche per le macchine dove attori come questi possano fare ricerca e sviluppo. Vedremo cosa ci riserverà il futuro e come l’uomo difenderà il proprio primato in questa lotta con le macchine.

💣 15 TOOL DA NON PERDERE

🤖 8 APPROFONDIMENTI SULL’AI GENERATIVA

Dopo aver chiesto di mettere in pausa l'AI, Musk lancia x.ai per accelerarla.

Per OpenAI GPT-5 non è la priorità. La priorità è migliorare GPT-5.

Anche Amazon entra nel mercato dell'Intelligenza Artificiale Generativa.

Al prossimo numero, nel frattempo scopri cosa puoi fare:

Ci sentiamo presto la newsletter ha cadenza quindicinale, nel frattempo puoi: